日本におけるAI利用に関する意識調査

内閣官房長官を議長とする統合イノベーション戦略推進会議に設置されたAI戦略会議の下に発足したAI制度研究会の中間とりまとめ(以下「中間とりまとめ」という。)が2025年2月4日に公表された。

中間とりまとめでは、AIに関する意識調査の結果が紹介され、日本は、「現在の規則や法律でAIを安全に利用できると思う」と回答した者が13%と調査対象国の中で最も低く、「AIには規制が必要だと思う」と回答した者の割合が調査対象国の中位に位置し、「AIリスクに関わるアプリケーションやITツールの導入を検討、または導入を進めている」、「具体的なAIリスク方針ガイドライン策定の準備を進めている」などAIリスクへのガバナンス施策の取組みについては、米国よりも総じて進んでいない状況が明らかにされている。

このような意識調査の結果は、日本におけるAIの利用が他国よりも遅れていることを窺わせ、その理由の一つとして、日本ではビジネス上のリスクが強調されるあまり、事業者において、リスクをおそれてAIの利用に踏み切れていないという現状が少なからずあるように思われる。

AIの積極的活用のためのAIガバナンス

一方で、AI(とりわけ生成AI)は日々急速に進歩しており、日本の事業者による利用が進まなければ、利用が進んでいく他国と違い、AIという技術革新の便益を十分に享受することができず、国際的な競争に耐えられなくなることが懸念される。また、事業の現場においても、例えば、個人による生成AIの利用が徐々に普及しつつある現状において、事業者自らが生成AIを導入していない場合、従業員が個人的に生成AIを業務に利用してしまい、何らかのトラブルにつながるおそれもある。したがって、日本においても、AIの開発及び利用がより積極的に推進されることが必要であり、そのためには、個々の事業者が、AIの利用によるリスクを、具体的なAIの利用方法を前提に適切に把握し、対処できるようにならなければならない(なお、人工知能関連技術の研究開発及び活用の推進に関する法律(以下「AI法」という。)18条1項に基づき策定される予定の「人工知能基本計画」の骨子(叩き台)では、基本構想として、「今こそ、AIの利活⽤及び開発、すなわちAIイノベーションの推進をはじめ、我が国としてAIに関する国家戦略構築が不可⽋。」と謳われている。)。

この点、2024年4月に総務省・経済産業省により公表されたAI事業者ガイドライン(現在は第1.1版(令和7年3月28日付))においても、「AIガバナンス」が「AIの利活⽤によって⽣じるリスクをステークホルダーにとって受容可能な⽔準で管理しつつ、そこからもたらされる正のインパクト(便益)を最⼤化することを⽬的とする、ステークホルダーによる技術的、組織的、及び社会的システムの設計並びに運⽤」と定義されているように、AIの利用によって生じるリスクについては、単にこれを抽象的におそれるのではなく、事業者が主体的にコントロールしていくことが求められているといえる。

AIガバナンスについては、既に先進的な取り組みを行っている事業者もあると考えられる一方で、そもそもAIの利用によって生じるリスクにどのようなものがあるかを具体的に想像ないし把握することができず、漠然としたリスクを恐れてAIの利用に踏み切れていない事業者も存在すると思われる。

以下では、事業者がAIの利用にあたって解決すべき課題が何なのかを検討する際の参考となるよう、AIの利用に関連して生じうるリスクにはどのようなものがあるかを整理したい。

以下では、事業者がAIの利用にあたって解決すべき課題が何なのかを検討する際の参考となるよう、AIの利用に関連して生じうるリスクにはどのようなものがあるかを整理したい。

AIの利用から生じるリスクの多様性

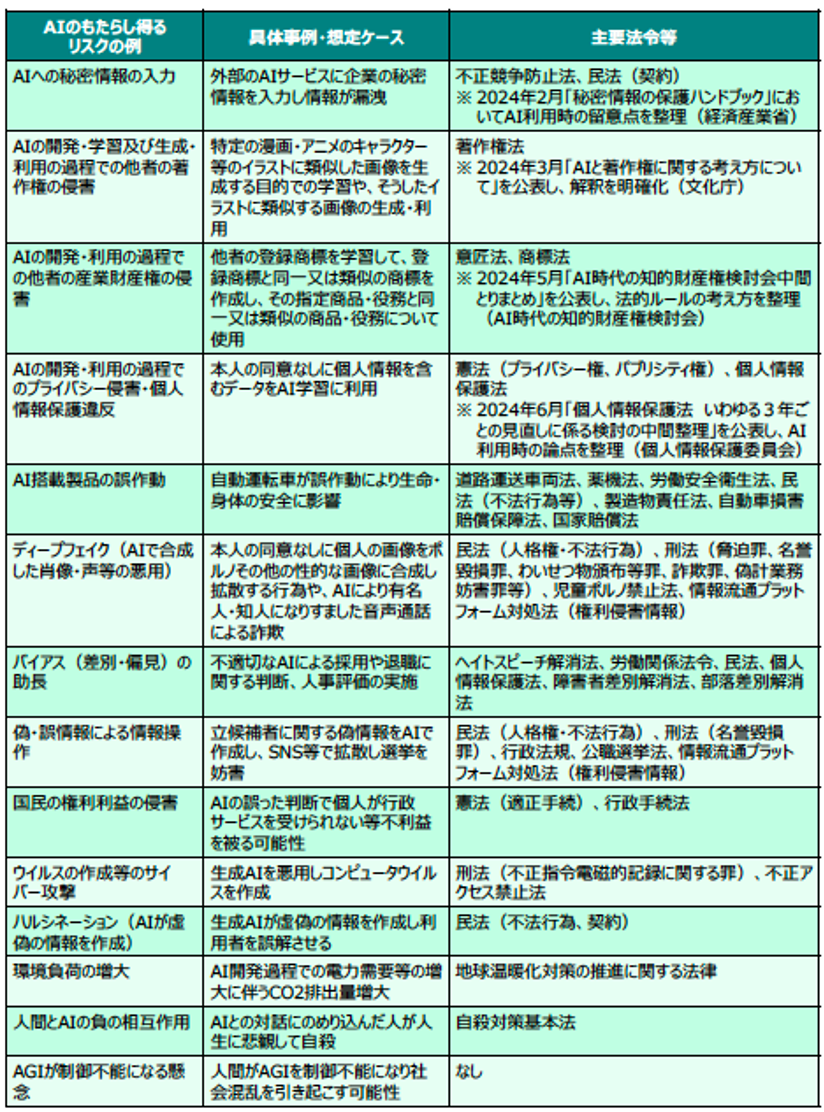

AIの利用によって生じるリスクに関しては、中間とりまとめ内でも整理されており、網羅的で、かつ、わかりやすい。

その内容は以下のとおりである(中間とりまとめ 図3「AIのもたらし得るリスク」を引用)。

その内容は以下のとおりである(中間とりまとめ 図3「AIのもたらし得るリスク」を引用)。

このようにAIの利用について懸念されるリスクは多様であり、その多くには法律も関連し、法分野は多岐にわたる。

事業者は、AIを事業活動において利用するにあたって、利用を検討しているAIの具体的な利用方法等を踏まえ、検討して対処しなければならない法的リスクを把握し、AIの利用に向けていかに対応するかを判断しなければならない。

その際、上記に整理を参照することによって、利用を検討しているAIについて、把握しなければならないリスクの見落としを防止するだけでなく、特に気をつけなければならないリスクが何であるのかを把握し(リスクの特定と軽重の評価)、そのリスクの内容に応じた適切な対応を検討しやすくなるであろう。

なお、令和7年5月28日にはAI法が成立し、同年6月4日に公布されている。この法律は、事業者に対して具体的な行為義務を課したり、事業者の禁止行為を定めたものでもないため、「AI法違反」というリスクは現時点で存在しない(AI法の概要については、本ウェブサイトの「日本におけるAIに対する法規制について」という北村幸裕弁護士の2025年7月4日付記事を参照されたい。)。

事業者は、AIを事業活動において利用するにあたって、利用を検討しているAIの具体的な利用方法等を踏まえ、検討して対処しなければならない法的リスクを把握し、AIの利用に向けていかに対応するかを判断しなければならない。

その際、上記に整理を参照することによって、利用を検討しているAIについて、把握しなければならないリスクの見落としを防止するだけでなく、特に気をつけなければならないリスクが何であるのかを把握し(リスクの特定と軽重の評価)、そのリスクの内容に応じた適切な対応を検討しやすくなるであろう。

なお、令和7年5月28日にはAI法が成立し、同年6月4日に公布されている。この法律は、事業者に対して具体的な行為義務を課したり、事業者の禁止行為を定めたものでもないため、「AI法違反」というリスクは現時点で存在しない(AI法の概要については、本ウェブサイトの「日本におけるAIに対する法規制について」という北村幸裕弁護士の2025年7月4日付記事を参照されたい。)。

以下では、多くの事業者において実際に生成AIが用いられているであろう、身近な生成AI利用方法(画像の作成、議事録の作成等)を例に、事業者が外部提供による生成AIの利用にあたってどのようなリスクに留意しなければならないかをシミュレーションする。

なお、AIの利用に関連して生じ得るリスクは上記のとおり様々あるところであるが、以下では、法的なリスクを念頭におく。

※AIの利用に関するリスクについては、本ウェブサイトに掲載されている森貞涼介弁護士「AIと不法行為(前編)(後編)」、中川雄矢弁護士「AI与信とその問題点」、増田朋記弁護士「AIを活用したマーケティング手法と消費者の選択に与える影響」も参照されたい。

なお、AIの利用に関連して生じ得るリスクは上記のとおり様々あるところであるが、以下では、法的なリスクを念頭におく。

※AIの利用に関するリスクについては、本ウェブサイトに掲載されている森貞涼介弁護士「AIと不法行為(前編)(後編)」、中川雄矢弁護士「AI与信とその問題点」、増田朋記弁護士「AIを活用したマーケティング手法と消費者の選択に与える影響」も参照されたい。

画像作成に生成AIを利用する場合の留意点

ここでは、事業者が、既存の著作物を入力することなく、広告等の作成のために生成AIを利用して画像生成を行ったり、あるプロジェクトで用いるロゴやキャラクター等を生成AIに作成させることを念頭において、留意すべき法的リスクを考えたい。

著作権侵害のリスク

第1に検討すべきは著作権である。著作権法は、生成AIの開発・提供・利用、それぞれの場面において、満遍なく検討対象となり、現状、生成AIの利用に関する法的リスクとしては最も関心が寄せられている法分野といってよい。

生成AIを開発し、それを用いたサービスを提供し、あるいは利用者として生成AIに関するサービスを利用することと、著作権法との関係については、文化庁が2024年3月15日に公表した「AIと著作権に関する考え方について」や、内閣府が2024年5月に公表した「AI時代の知的財産権検討会」の中間とりまとめ(こちらについては、当職の2024年6月28日付「内閣府「AI時代の知的財産権検討会」中間とりまとめについて」という記事において概説している。)において、具体的に整理されている。

これらはあくまでも法律ではなく、著作権侵害の有無に関する最終的な判断は裁判所による司法判断に委ねられているが、現時点での生成AIと著作権の関係が網羅的に整理されており、生成AIの利用における著作権侵害の問題を検討する場合に参照されるべきものである。

生成AIを開発し、それを用いたサービスを提供し、あるいは利用者として生成AIに関するサービスを利用することと、著作権法との関係については、文化庁が2024年3月15日に公表した「AIと著作権に関する考え方について」や、内閣府が2024年5月に公表した「AI時代の知的財産権検討会」の中間とりまとめ(こちらについては、当職の2024年6月28日付「内閣府「AI時代の知的財産権検討会」中間とりまとめについて」という記事において概説している。)において、具体的に整理されている。

これらはあくまでも法律ではなく、著作権侵害の有無に関する最終的な判断は裁判所による司法判断に委ねられているが、現時点での生成AIと著作権の関係が網羅的に整理されており、生成AIの利用における著作権侵害の問題を検討する場合に参照されるべきものである。

では、生成AIを用いて、ある画像を作成したとき、当該画像が著作権侵害となるか。AI生成画像が第三者の著作物と異なっているのであれば、著作権侵害の問題は生じないが、第三者の著作物と類似していた場合には、当該第三者の著作権を侵害しているおそれがある。

著作権侵害の有無を判断する際には、既存の著作物と類似しているかどうか(類似性)、類似しているとしても当該既存の著作物に依拠して作成・利用されているものかどうか(依拠性)が問題となる。

ここで、生成AIの場合、その開発のために誰かの著作物が利用されていたことを利用者が認識していなかったとしても、生成AIによって当該著作物に類似したものが生成される場合があるところ、生成AIの利用者自身は既存の著作物の存在を認識していなかったときでも、AI学習用データに当該既存の著作物が含まれていれば、客観的には当該著作物へのアクセスがあったということになる以上、依拠性があったと通常推認されてしまうことに注意が必要である。つまり、利用者としては、当該生成AIの開発段階で既存の著作物が利用されているかどうかを把握していなくとも、結果として、既存の著作物と類似する画像が生成されてしまえば、著作権侵害となるリスクがあるということである。

そのため、利用者としては、生成された画像が、既存の著作物と類似していないかどうかをチェック(例えば、Google画像検索を用いることが考えられる。)してから、当該画像を使用すること等により、著作権侵害によるリスクを低減することが考えられる。また、AI生成画像に対して、従業員等の人間が実際に手を加えることによって、類似性がないものに変えるという対処も考えられる。

ここで、生成AIの場合、その開発のために誰かの著作物が利用されていたことを利用者が認識していなかったとしても、生成AIによって当該著作物に類似したものが生成される場合があるところ、生成AIの利用者自身は既存の著作物の存在を認識していなかったときでも、AI学習用データに当該既存の著作物が含まれていれば、客観的には当該著作物へのアクセスがあったということになる以上、依拠性があったと通常推認されてしまうことに注意が必要である。つまり、利用者としては、当該生成AIの開発段階で既存の著作物が利用されているかどうかを把握していなくとも、結果として、既存の著作物と類似する画像が生成されてしまえば、著作権侵害となるリスクがあるということである。

そのため、利用者としては、生成された画像が、既存の著作物と類似していないかどうかをチェック(例えば、Google画像検索を用いることが考えられる。)してから、当該画像を使用すること等により、著作権侵害によるリスクを低減することが考えられる。また、AI生成画像に対して、従業員等の人間が実際に手を加えることによって、類似性がないものに変えるという対処も考えられる。

商標権侵害等のリスク

生成AIによって、ロゴを作成しようとする場合、AI生成画像が第三者が商標登録しているロゴと類似していれば、それを使用することが商標権侵害となるおそれがある。そのため、AI生成物が、第三者の登録商標に類似していないかどうかの確認が必要である。その方法としては、上記著作権の場合と同様、まずはGoogle画像検索で類似しているものがないかを確認し、万が一、類似するものが見つかった場合には、そこから得られた情報を元に、商標登録の有無等を特許庁のJ-PlatPat( https://www.j-platpat.inpit.go.jp/ )で確認し、商標権侵害のおそれを具体的に検討することが考えられる(場合によっては第三者の登録意匠や不正競争防止法上の不正競争行為にも配慮が必要である。)。

なお、このような作業は、生成AIを使用してロゴ等の画像を作成した場合と、人の手によってロゴ等の画像を作成した場合とで異ならない。商標権との関係では、AI特有の考慮要素は想定し難く、AI生成物に関する商標権侵害の判断も、従来の商標権侵害の判断と同様に行われるということになる。

なお、このような作業は、生成AIを使用してロゴ等の画像を作成した場合と、人の手によってロゴ等の画像を作成した場合とで異ならない。商標権との関係では、AI特有の考慮要素は想定し難く、AI生成物に関する商標権侵害の判断も、従来の商標権侵害の判断と同様に行われるということになる。

肖像権・パブリシティ権侵害のリスク

生成AIによって人物の画像を生成し、これを利用する場合には、肖像権やパブリシティ権に配慮する必要がある。生成AIが生成した画像が肖像写真や肖像画の場合、生成された肖像が実在の人物に似ているとして肖像権やパブリシティ権の侵害を主張される可能性があるからである。

肖像権やパブリシティ権の侵害主張をあらかじめ回避すべく、画像を生成するにあたっては、特定の人物の画像を無断で利用するようなことがないよう留意すべきである。また、そのように留意していた場合でも、生成AIによって、意図せず、誰かに似ている生成物が作られる可能性もある。それが誰しもがわかる著名人であれば、当該生成物をそもそも利用しないことによって、あるいは、画像をさらに加工することによって、権利侵害を主張されないよう対応することが考えられる。一方で、著名人ではなくとも、誰かに似てしまっている可能性もゼロとはいえないことから、念のため、Google画像検索等を用いて、同様の人物写真等が出てこないかを確認することが考えられる。

肖像権やパブリシティ権の侵害主張をあらかじめ回避すべく、画像を生成するにあたっては、特定の人物の画像を無断で利用するようなことがないよう留意すべきである。また、そのように留意していた場合でも、生成AIによって、意図せず、誰かに似ている生成物が作られる可能性もある。それが誰しもがわかる著名人であれば、当該生成物をそもそも利用しないことによって、あるいは、画像をさらに加工することによって、権利侵害を主張されないよう対応することが考えられる。一方で、著名人ではなくとも、誰かに似てしまっている可能性もゼロとはいえないことから、念のため、Google画像検索等を用いて、同様の人物写真等が出てこないかを確認することが考えられる。

議事録作成に生成AIを利用する場合の留意点

事業活動では、様々な会議が開催され、取締役会議事録など作成が法的に義務付けられているものだけでなく、内部的な記録のために議事録が独自に作成されることも多い。

従前は、議事録作成担当者が会議の現場でメモを取って議事録化し、あるいは、会議内容を録音しておき反訳にかけて議事録としてまとめあげたりしていたものが、生成AIを利用することによって、会議内容が自動的に文章化されるだけでなく、議事録化のために一瞬で要約を作成することも可能になった。議事録作成は手間のかかる作業であることから、生成AIの身近な利用場面の一つといえる。

従前は、議事録作成担当者が会議の現場でメモを取って議事録化し、あるいは、会議内容を録音しておき反訳にかけて議事録としてまとめあげたりしていたものが、生成AIを利用することによって、会議内容が自動的に文章化されるだけでなく、議事録化のために一瞬で要約を作成することも可能になった。議事録作成は手間のかかる作業であることから、生成AIの身近な利用場面の一つといえる。

秘密情報保持義務違反、営業秘密性喪失のリスク

取引先等との間で秘密保持契約を締結しており、当該契約において「秘密情報」として定義された情報に該当する取引先等に関する情報が、会議の場においてやりとりされる場合、出席者の発言が録音され、生成AIに取り込まれることが、秘密保持義務違反に当たらないかどうかが問題となり得る。

この点は、取引先等との間で締結されている秘密保持契約の内容次第ということになるが、筆者の経験上、秘密保持契約において生成AIの利用を想定した条項が設けられていることは現状少なく、議事録作成のために秘密情報に該当する情報が議事録作成のため生成AIに取り込まれることは、契約違反(第三者開示禁止違反、目的外利用禁止違反)に当たると評価される可能性がある。

そのため、秘密保持契約に基づき開示を受けた情報が取り扱われる可能性がある会議においては生成AIをそもそも利用しないといった対応が安全である。

また、取引先等から取得した秘密情報だけでなく、自社の営業秘密との関係でも留意が必要になる。会議の議題として、自社が不正競争防止法上の営業秘密として評価されるべく管理している情報がやりとりされる場合、例えば、当該情報が、利用規約上、生成AIに取り込まれることによって、生成AIのベンダー側の開発に利用される契約となっている場合には、秘密管理性がないと評価される事情となり得る。したがって、自社が秘密として管理している情報が扱われるような会議においても、生成AIを利用した議事録作成は行わないことが安全であろう。

この点は、取引先等との間で締結されている秘密保持契約の内容次第ということになるが、筆者の経験上、秘密保持契約において生成AIの利用を想定した条項が設けられていることは現状少なく、議事録作成のために秘密情報に該当する情報が議事録作成のため生成AIに取り込まれることは、契約違反(第三者開示禁止違反、目的外利用禁止違反)に当たると評価される可能性がある。

そのため、秘密保持契約に基づき開示を受けた情報が取り扱われる可能性がある会議においては生成AIをそもそも利用しないといった対応が安全である。

また、取引先等から取得した秘密情報だけでなく、自社の営業秘密との関係でも留意が必要になる。会議の議題として、自社が不正競争防止法上の営業秘密として評価されるべく管理している情報がやりとりされる場合、例えば、当該情報が、利用規約上、生成AIに取り込まれることによって、生成AIのベンダー側の開発に利用される契約となっている場合には、秘密管理性がないと評価される事情となり得る。したがって、自社が秘密として管理している情報が扱われるような会議においても、生成AIを利用した議事録作成は行わないことが安全であろう。

個人情報保護法違反のリスク

会議における発言に、社内で整理・管理されている個人情報(個人データ)が含まれる場合、議事録作成のため生成AIに当該個人情報が取り込まれることが、個人情報保護法上の第三者提供を制限する規定(個人情報保護法27条)に違反しないかどうかが問題となる(なお、そもそも会議において個人情報を含む発言がなされること自体は、当該個人情報を取得した目的の範囲内の利用と考えられる。)。

生成AIに取り込まれる個人情報が、当該生成AIのサービスの利用規約上、ベンダー側の開発などの応答結果の出力以外の目的に利用され得る場合には第三者「提供」に当たると考えられる(クラウド例外の問題)。個人情報の第三者提供にあたる場合でも、それが利用目的達成のための個人情報取扱いの委託であれば、そもそも提供先は「第三者」に当たらないが(同法27条5項1号)、利用規約上、当該個人情報がベンダーによる開発に利用されることになるのであれば、それは通常、利用目的の範囲外と評価されると考えられ、第三者「委託」と整理すること(本人の同意を不要とすること)も困難であろう。

要するに、生成AIのベンダー側が、生成AIに取り込まれた個人情報をどのように扱えるのかを確認することが重要である。

生成AIに取り込まれる個人情報が、当該生成AIのサービスの利用規約上、ベンダー側の開発などの応答結果の出力以外の目的に利用され得る場合には第三者「提供」に当たると考えられる(クラウド例外の問題)。個人情報の第三者提供にあたる場合でも、それが利用目的達成のための個人情報取扱いの委託であれば、そもそも提供先は「第三者」に当たらないが(同法27条5項1号)、利用規約上、当該個人情報がベンダーによる開発に利用されることになるのであれば、それは通常、利用目的の範囲外と評価されると考えられ、第三者「委託」と整理すること(本人の同意を不要とすること)も困難であろう。

要するに、生成AIのベンダー側が、生成AIに取り込まれた個人情報をどのように扱えるのかを確認することが重要である。

なお、上記は議事録作成を目的とした生成AIの利用場面についてであるが、日常業務において従業員がChat GPTなどの生成AIを気軽に使用してしまう場面も想定され、個人情報や営業秘密等を含むプロンプトを入力することについては同様の留意が必要になる。上記のとおり、取引先との契約や生成AIの利用規約の内容によっては違反がないと評価できる場合もあるということになるが、当該契約や利用規約を精査、検討できていない段階では、そもそも従業員がこれらの情報を生成AIに入力しないようルール化等することが安全と考えられる。

さいごに

本記事では、AIの利用によって生じ得るリスクを概観し、生成AIの利用場面において、生成AIの利用による法的リスクにどのようなものがあるかを把握し、どのように対処することが考えられるかを具体的に検討した。

今後、AI法に基づく基本計画が策定されるなどし、日本全体でAIの利用が加速していくものと思われる。その流れに遅れないよう、本記事がAIの具体的な利用に踏み切る一助になれば幸いである。

今後、AI法に基づく基本計画が策定されるなどし、日本全体でAIの利用が加速していくものと思われる。その流れに遅れないよう、本記事がAIの具体的な利用に踏み切る一助になれば幸いである。